2024 年は人工知能にとって飛躍的な年となり、大手テクノロジー企業の中で最も成長した企業は Meta です。ザッカーバーグ氏のスタッフは、自社のオープンソース AI である LlaMa の機能が不十分なバージョンを持っていたため、OpenAI の ChatGPT や Google の Gemini と真っ向から競争するためにLlama 3 を採用しました。少なくとも、それが各新しいバージョンで提示されるテストで示されていることです。

Llama 3.1 のリリースから数か月が経ち (中国が悪用の先頭に立っている)、Mark Zuckerberg は、彼の新しい主要言語モデルであるLlama 3.2 を発表しました。番号付けの小さな変更にもかかわらず、この新しい AI には大きな目新しさが備わっています。それは、マルチモーダルになったことです。これは、主要な競合他社と同様に、このモデルが画像やビデオに含まれるものを処理して理解できることを意味します。テキストの場合、はい、最大のモデルは引き続き Llama 3.1 405B になります。

WhatsApp、Instagram、Facebook からのニュース (スペインではまだ利用できません)

Meta AI が利用可能な市場では、メタ AI はすでに WhatsApp、Instagram、または Facebook にテキスト チャットボットとして統合されています。しかし、これまでは、OpenAI がモバイル アプリで実証したように、自然言語の音声でリアルタイムに会話を行うことはできませんでした (そうです、その声はまさにスカーレット ヨハンソンを彷彿とさせます)。

Meta AI Voiceを使用すると、同社はアシスタントと、オークワフィナ、ジョン・シナ、キーガン・マイケル・キー、クリステン・ベルなどの有名人のさまざまな声で話すことを提案しているため、状況は変わりました。現時点では米国でのみ利用可能です。 。

Llama 3.2 の統合のおかげで、T シャツの色の変更、画像へのアクセサリーやオブジェクトの追加、背景の変更など、実際の画像やすでに生成された画像への変更を音声やテキストでリクエストできるようになりました。 最新の Google Pixel に見られる AIの様子。 Instagram や WhatsApp との統合は、テストするまでもなく奥深いようです。たとえば、ストーリーを作成するときに、選択した画像に基づいて背景を生成するように Meta AI に依頼できます。

同社が示したように、Llama 3.2の画像分析により、たとえばケーキの画像をアップロードし、作り方を尋ねると、レシピを求めていることをAIが自動的に認識できるようになる。それを理解した上で、彼はそれを書くだろう――

メタは開発者に無料で強力な武器を提供し続けます

Llama 3.2 のマルチモーダル要素は、開発者がこれを使用して (モデルを動かすハードウェアが許可している限り) ビデオや画像をリアルタイムで分析できることを意味し、 GPTで見られるものに近づけることができます。 4oまたはGemini Flash 。ビデオを分析して、そこに映るすべてを伝えることができます。他のモデルとは異なり、Llama 3.2 はオープンソースのままであるため、 Ray-Ban Metaメガネなどの無料または独自のハードウェアと組み合わせることで、すべてが変わる可能性があります。はい、 細かいニュアンスはありますが、オープンソースです。

開発者は、ニーズに応じて、2 つのマルチモーダル フレーバーで Llama 3.2 を使用できます。 1 つ目は 11,000 万のパラメータを持ち、2 つ目はより強力で 90,000 万のパラメータを持ちます。

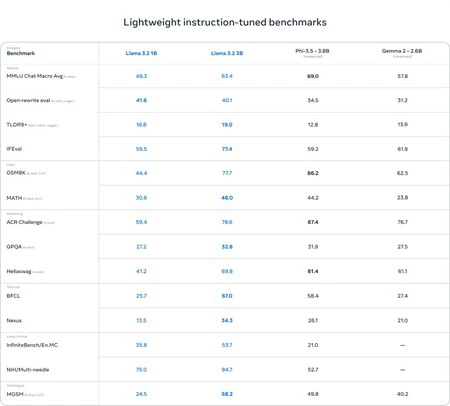

これに、10 億個のパラメータと 30 億個のパラメータを備えた軽量のテキスト モデルが追加されています。これは、さまざまなプロジェクトで多用されている 80 億個のモデルよりも小さく、高速です。彼らのアイデアは、Qualcomm または Mediatek のモバイル ハードウェア上で流動的かつローカルに作業できるということです。

マーク・ザッカーバーグ氏はイベントでのスピーチの中で、Llamaのオープンソースの性質と、LlamaがAIエコシステムで生み出すものを改めて強調した。彼は、閉鎖的な AI 企業がコストを削減することで Llama に対応していると述べ、オープンソースが単に経済的な理由でこの戦いに勝つと信じていると強調しています。現実には、これまで、イノベーションにおいては常に OpenAI に後れを取っていました。

画像 |ゴール

詳細情報 | ゴール