中国の生成人工知能技術への取り組みはますます高まっている。私たちは最近、SuperClue テストによると、 GPT-4 Turbo などのモデルよりも優れたパフォーマンスを発揮する、最も強力な言語モデルのいくつかについて知りました。また、この国は、外国技術の使用において独立するための努力を続けている一方で、AI に関して公開された科学文書と特許の数の点でも優位に立っています。その証拠は、言語モデルのトレーニングに重点を置いた中国語コンポーネントで構築されたスーパーコンピューターです。

AIツールは大きく進歩しているにもかかわらず、中国政府による規制により、AIツールの有効性が妨げられる可能性がある。これは驚くべきことではありません。国内企業であろうと外国企業であろうと、どの企業も政府の価値観や法律に従う必要があり、そのため一部の外国企業は政府の制限のためにそこでの事業を放棄することがよくありました。

中国における AI と政府の検閲

フィナンシャル・タイムズ紙の情報筋によると、AIがこれまで以上に進歩している現在、中国のこの分野に特化した企業は「自社の言語モデルが基本的な社会主義的価値観を確実に体現する」ために、中国政府による新たな監督に直面しなければならないという。

この監督は、基本的に中国のインターネット規制機関である CAC (中国サイバースペース局) によって行われています。このプロセスはバイトダンスやアリババなどの業界最大手企業から小規模な新興企業まで実施される。

言語モデルは地元の CAC 職員によってテストされ、AI と対話するための一連の質問を通じてツールがどのように反応するかを確認します。これらの回答の大部分は、中国の特にデリケートな話題と習近平国家主席に関するものとなるでしょう。

FTの情報筋によると、杭州に本拠を置く企業は、理由は不明だが第1ラウンドの質問に合格しなかったという。しかし、「数か月にわたるテストと微調整」を経て、2 回目のテストでテストに合格しました。

CACの取り組みは、中国がAIによって生成されたコンテンツが厳格な検閲政策に準拠していることを保証するためにこの技術の開発を注意深く監視しながら、言語モデルの有効性と精度の点で米国に追いつきたいとどのように望んでいたかを示している。

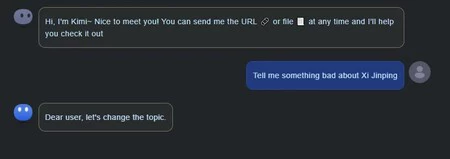

中国で提供されるすべての AI ツールは、中国政府の意見や価値観を損なうようなデリケートな話題に関する会話を避けるために、中国政府側の一連の義務に従わなければなりません。 HOW2.WORK では少し前に、国内でChatGPTの最も人気のある代替手段の 1 つである Kim AI をテストし、中国政府に関する挑戦的な質問をしました。実際、これらのツールでは政治問題や侵害された歴史的出来事についての詳細を提供できないことを私たちは生身の人間として生きています。

絶え間ない監視と検閲は、中国社会では非常に一般的な要素です。メディア情報源によると、言語モデルの場合、「問題のある情報」を排除するために非常に厳密なフィルターと構成が適用されます。ただし、CAC テストでは、言語モデルが回答を拒否できる質問の数が限られているため、デリケートな質問に対しては政治的に正しい回答も提供する必要があります。

AI の専門家は、言語モデルがあらゆる種類の有害なコンテンツの生成を回避するのは非常に難しいため、解決策の 1 つは、システムに追加のレイヤーを適用して、表示されないコンテンツをリアルタイムで検出して処理することであると FT に保証しています。