📖

OpenAI には、GPT からより良い結果を得るための戦略と戦術を共有するガイドがあります。この会社は、よく知られているChatGPTとGPT-4 を市場に提供しています。同社は、より良い結果を得るために組み合わせることができる方法があることを思い出させ、ユーザーが自分のニーズに最も適した方法を見つけるために実験することを奨励しています。

ここに示した例の一部は、現時点では最も強力なモデルである gpt-4 でのみ動作します。まだ gpt-4 にアクセスできない場合は、待機リストに登録することを検討してください。

そして、さらにアドバイスを与える前に、非常に重要な点に留まらなければなりません。GPT はユーザーの心を読み取ることができないため、非常に長い結果を受け取った場合は短い回答を求めることができ、その逆も同様です。必要なものではない形式でテキストが提供された場合は、それを AI に書き込むだけで、書き方を変更できます。

OpenAI は、より良い結果を達成するための 6 つの戦略をまとめました。このガイド全体を通じて、同社は GPT モデルには誤りが生じる可能性があり、その結果を絶対的な真実として受け取るべきではないことを思い出させます。したがって、適切で真実な結果を求めている場合は、ユーザーが望むものを適切に提案、定式化、再定式化する責任があります。

参考テキストを提供します

GPT は「特に難解な話題や引用や URL について尋ねられた場合、誤った答えをでっち上げる可能性があります。」 OpenAI 自体がそう言っていますが、忘れてはならないのは、その言語モデルに関する最大の不満の 1 つは、正確に言えば、OpenAI が提供する情報のソースが絶対的な真実であるかのように提供されていないことであり、それが問題です。欧州連合は解決策を見つけたいと考えている。

したがって、GPT ソフトウェアに参照テキストを提供することで、「より少ない発明で対応できる」と製造会社は述べています。質問をし、参考テキストといくつかの参考引用を使用して回答すると言います。

複雑なタスクをより単純なサブタスクに分割する

ソフトウェア エンジニアリングにおいて、複雑なシステムをモジュール式コンポーネントのセットに分解することが良い習慣であるのと同様に、GPT に依頼するタスクにも同じことが当てはまります。

複雑なタスクは、単純なタスクよりもエラー率が高くなる傾向があります。

この前提の下、ChatGPT の作成者自身が発したこのフレーズは、タスクを部分的に実行することを推奨しています。言い換えれば、あなたが分析しなければならないトピックについて複数ページのエッセイを書くように彼に頼むのではなく、あなたが分析したいさまざまなポイントを細分化してください。最後に、AI は人間ではないため、信頼できる結果を達成するには自分の役割を果たさなければなりません。

たとえば、密度の高いトピックに関するテキストや分析が必要な場合は、結果を部分単位でリクエストします。要約したい非常に長い文書を送信するのではなく、最も興味のある部分を選択して AI に送信します。

GPT に「考える」時間を与える

OpenAI によると、 GPT は時間をかけて応答を作成するよりも、すぐに応答しようとするときに推論エラーが多くなります。 AI に時間を与えていることを知らせるために、「答えを提供する前の一連の推論」を AI に要求することができます。これは、GPT がより信頼性の高い結果に至るまでの推論に役立ちます。

つまり、結論を求める前に、AI にその応答を「理由づけ」するように指示します。結果を取得したときに、最終的な答えを導き出すために理論を見落とした可能性があるかどうかを判断して、AI が内容を再加工できるようにすることもできます。

外部ツールを使用する

GPT AI を補完できるツールがあります。たとえば、コード実行エンジンは、GPT が数学演算を実行してコードを実行するのに役立ちます。

ツールが GPT よりも確実または効率的にタスクを実行できる場合は、それをダウンロードして両方の利点を最大限に活用してください。

外部情報ソースが提供されている場合、モデルはそれを利用できます。これは、モデルがより多くの情報に基づいた最新の応答を生成するのに役立ちます。たとえば、ユーザーが特定の映画について質問した場合、その映画に関する高品質の情報をモデル入力に追加すると便利です。

OpenAI によると、「テキストのコーパスを複数のチャンクに分割し、各チャンクを埋め込んで保存できます。その後、指定されたクエリを埋め込み、ベクトル検索を実行して、コーパス内の埋め込まれたテキスト チャンクのうち、クエリに最も密接に関連するテキスト チャンクを見つけることができます。」お問い合わせ「ご相談」。

GPT は、それ自体で算術計算や長い計算を正確に実行することはできません。必要に応じて、モデルは独自の計算を実行する代わりに、コードを記述して実行するように命令できます。

具体的には、モデルは、トリプル バックティックなどの指定された形式で実行されるコードを入力するように命令できます。結果が得られたら、コードを抽出して実行できます。最後に、必要に応じて、コード実行エンジンの出力を次のクエリのモデルへの入力として提供できます。

コード実行のもう 1 つの良い使用例は、外部 API の呼び出しです。モデルに API の適切な使用方法を指示すると、それを利用するコードを作成できます。 API の使用方法を示すドキュメントまたはコード例を提供することで、モデルに API の使用方法を指示できます。

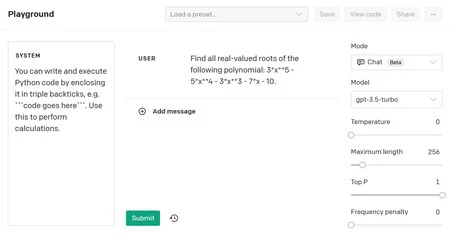

たとえば、上の画像にあるように、 GPT ベースのモデルは「Python コードを 3 つの引用符で囲んで記述し、実行する」ことができます。

テストは体系的に変更されます

パフォーマンスを測定できれば改善が容易になります。このため、OpenAIは、結果が完全に満足できない場合、または結果が正しいかどうかを確認したい場合は、一部の命令を変更してAIにタスクの実行を再度依頼できると述べています。

上記の各戦略は、特定の戦術を使用して適用できます。これらの戦術は、試してみるべきことのアイデアを提供することを目的としています。

結果の評価は、コンピュータ、人間、またはその両方の組み合わせによって実行できます。たとえば、 OpenAI Evals は、自動評価を作成するツールを提供するオープン ソース ソフトウェア フレームワークです。

モデルベースの評価は、同等の品質とみなされるさまざまな結果が考えられる場合 (たとえば、回答が長い質問の場合) に役立ちます。 「モデルベースの評価で現実的に評価できるものと人間による評価が必要なものとの境界は曖昧になり、モデルの機能が向上するにつれて常に変化しています」と OpenAI は述べています。