OpenAI は、近年最も革新的でエキサイティングな技術製品の 1 つであるChatGPT を開発していますが、同社には独自の明暗があり、会社のポリシーについて話すことに関しては非常に秘密主義です。ここ数カ月のサム・アルトマンのメロドラマと、 イリヤ・サツケヴァー(創設者の一人)の最近の退任に加え、新たな船の放棄があった。ジャン・ライケは彼の「スーパー・アライメント」チームの共同ディレクターであり、監督する立場にある。セキュリティの問題。 Jan Leike 氏は自身の進歩について語っていますが、OpenAI の業績はあまり良くありません。

OpenAI 環境を知っている人にとって、このニュースは驚くべきことではないでしょう。月曜日に同社は有望なChatGPT -4oを発表し、その数時間後の火曜日に Ilya Sutskever 氏が OpenAI の職を辞任しました。同社の元主任科学者の別れをきっかけに、ハッシュタグ「#WhatDidIlyaSee」(イリヤが見たもの)は、その起源であるアルトマン氏の短期間の解雇から数カ月後に再びTwitterのトレンドになった。 OpenAIで何が起こっているのでしょうか?

Jan Leike 氏が OpenAI に別れを告げる: 注目のセキュリティ

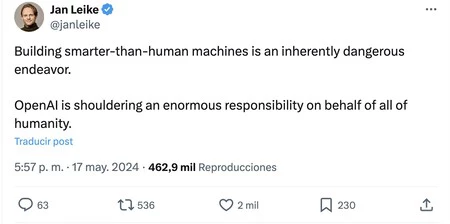

数時間前に公開された X (旧 Twitter) のスレッドで、Leike 氏は OpenAI との別れを説明しました。

したがって、同氏は、OpenAIが自分の研究に世界で最適な場所であるという理由でOpenAIに入社したにもかかわらず(彼は機械学習の研究者である)、 「会社の中核的優先事項についてOpenAIのリーダーシップと意見が一致せず」、限界点に達していた、と述べている。 。

ライク氏は、同社は「セキュリティ、監視、準備、保護、敵対者の強さ、(超)調整、機密保持、社会的影響および関連するトピック」にもっと重点を置くべきだと考えている。 「これらは少なからず、あるいは些細な問題ではない。彼は『これらの問題を解決するのは非常に困難であり、我々がそこに至る道を進んでいないのではないかと懸念している』ということを考慮して決断を下した。」

ライケ氏は、OpenAI がその仕事に計り知れない責任を負っていることを明確にしています。「人間よりも知能の高い機械を構築することは、本質的に危険な仕事です」。そのため、これらの欠点はさらに深刻になっています。「近年、文化とセキュリティのプロセスは素晴らしいものに後回しにされています。」製品。’

ライケ氏は、大きな言語モデルを超えて、人間と同じように情報を処理するシステムである汎用人工知能 (AGI として知られる) に取り組むという同社の目標を非常に真剣に受け止めているようです。 AGI ‘。この意味で、彼は「私たちはできる限りの準備を優先する必要がある」と信じています。そうして初めて、AGI が全人類に確実に利益をもたらすことができるのです。」

Leike 氏の意見では、OpenAI は「セキュリティ第一の AGI 企業になる」必要があり、スタッフに「自分たちが構築しているものにふさわしい真剣さで行動する」ことを約束するよう求めています。

人工知能全般、特に OpenAI の背後にあるものを知っている人々の辞任は、この革新的なテクノロジーと、これまでのところそれを実行する上で最も有利な立場にある同社に対する不安を増大させる一因となっています。

表紙 | UnsplashのGrowtika氏の写真とTwitter の Jan Leike氏の写真を使用したモンタージュ