人工知能はここ数カ月で飛躍的に進歩しており、実際の成果や特定のタスクを非常に簡単に習得していることがすでにわかります。 2023 年は、DALL-E 2 、Copilot、MidJourney、Gemini などの発表が数多く行われたため、間違いなく歴史に残る年となりました。しかし、これは問題になる可能性があります。

AI の偉大な専門家の 1 人は、カリフォルニア大学教授のマーティン ヒルベルトです。彼はメディアElColombianoのインタビューに応じ、AI 専門家としてのビジョンについて語りました。とりわけ、このテクノロジーが私たちにもたらす課題と、それを社会関係を改善するためにどのように使用できるかに焦点を当ててきました。

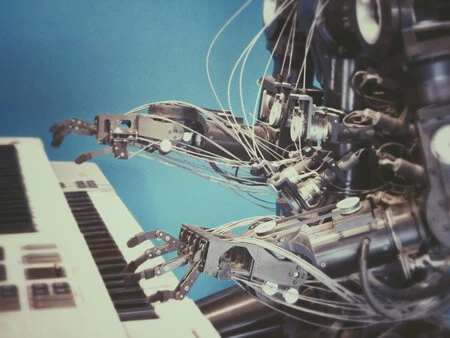

AIは危険な一歩を踏み出し続けている

人工知能で追求できる目標は、機械の知能を実証する能力を評価するツールであるチューリング テストを克服することでした。評価者が機械と人間を区別できない場合にテストに合格しますが、実際には、AI はすでに多くの面で人間と区別できなくなっています。

この影響は、米国の博士号の取得には「ChatGPT はいくつかの学術試験で人間を上回る成績を収めている」と専門家が述べているほどだ。医学や法律などの複雑な分野は現在、AI によって提供される答えとその精度によって危険にさらされています。

最も対立する点の 1 つは倫理であり、この専門家はそれを非常に懸念しています。ほんの数年前、誰もが AI がどのようなものになるかを指摘しており、このアイデアは興奮しながら語られていました。しかし、この夢は、AI の安全性を保証するために満たされるべき3 つの基本的なルールについても語っていますが、実際にはそうなっていません。これらは次のとおりです。

- インターネットには接続しないでください。

- 子供や精神的健康上の問題を抱えている人々との交流を避けてください。

- それ自体がプログラミングされるのを防ぎます。

しかし、これまで見てきたように、彼は誰とでも対話し、コードを効率的にプログラムする方法を示す「ミーム」が生成されたため、これらの点はすべて失敗しました。これにより「赤いボタンで簡単に電源を切れる時代は終わった」。

この専門家は、これらの課題に対処するために検討されている解決策についても敢えて語ります。その 1 つ目は、人工知能が人類の基本的な側面を自動化することを防ぐことと、「その使用を監査し制御するためのアルゴリズムの監督を確立する」ことです。 AIのメリットを積極的に活用する必要があることも認識しているが。

つまり、AIの「危険」は存在しており、その拡大と影響を制御し続ける必要性については専門家全員が同意している。現在の問題は、どのようにしてそれを正しく規制するかを知ることであり、それにはさまざまな当局の合意が必要であり、何よりも関係者の意志の力が必要となる。

画像 | 憑依写真エニオ